引言

随着工业自动化、机器人技术和智能无人系统的飞速发展,传统的2D视觉因其缺乏深度信息,在应对复杂场景、遮挡物体和精确空间定位时已力不从心。3D视觉引导技术应运而生,成为实现机器人“手眼协同”的关键。它通过获取环境的三维点云数据,为机器人提供了丰富的空间几何信息,从而实现精准的抓取、装配、检测等任务。然而,从原始3D数据采集到最终生成稳定可靠的引导指令,整个算法处理链路充满了挑战。本文将从算法处理层面,深入解析3D视觉引导中的核心问题与关键技术。

一、 数据之源:3D感知与点云获取的挑战

一切始于高质量的3D数据。目前主流的3D视觉传感器包括结构光、立体视觉、激光雷达和飞行时间法。它们在算法处理层面首先面临以下问题:

1.数据噪声与密度不均:

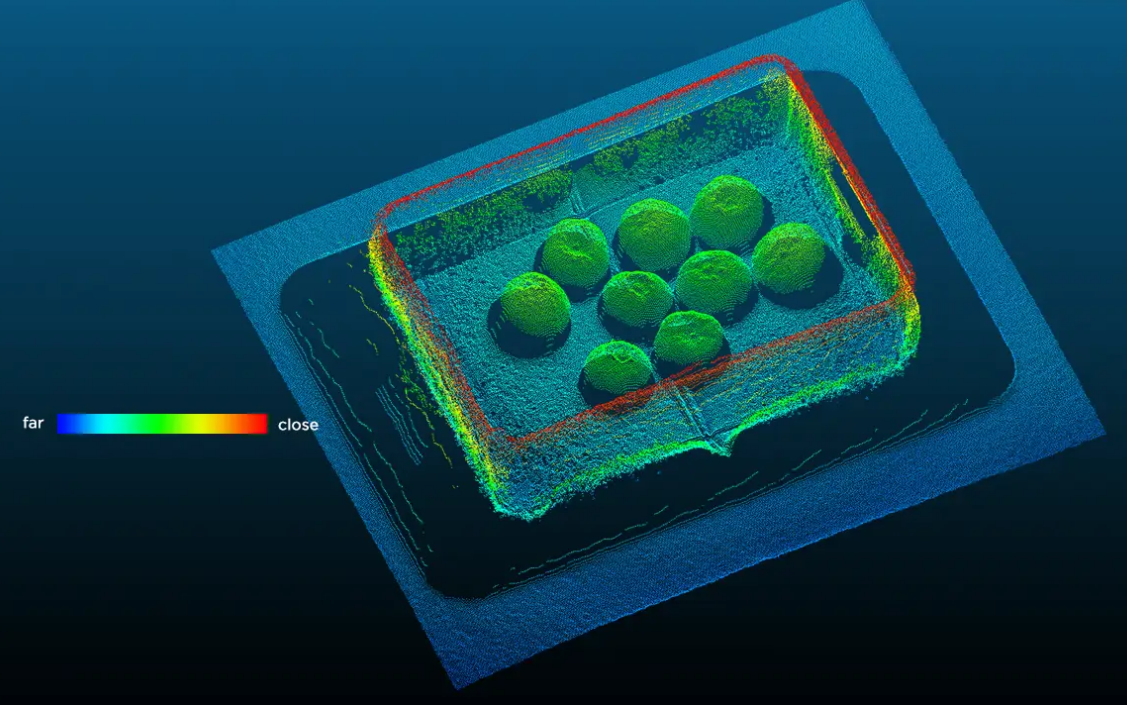

l问题:传感器易受环境光、物体表面材质(如高反光、透明、深色吸光)干扰,导致生成的点云存在大量噪声(离群点)或数据缺失(孔洞)。点云密度也可能因距离和角度而不均匀,影响后续特征提取的准确性。

l分析:这是底层数据的“信噪比”问题。算法必须在预处理阶段进行有效的点云滤波(如统计滤波、半径滤波)和点云补全,为后续步骤提供一个“干净”的数据集。

2.分辨率与精度的权衡:

l问题:高分辨率意味着更密集的点云和更丰富的细节,但同时也带来了巨大的数据量和处理耗时。在高速生产线上,必须在3D视觉系统的精度和速度之间找到平衡点。

l分析:这要求算法设计时考虑多尺度处理策略,或采用基于深度学习的自适应采样方法,在保留关键特征的前提下,有效降低数据维度。

二、 场景之解:点云分割与目标提取的困境

获得“干净”的点云后,核心任务是从复杂的场景中分离出我们关心的目标物体,即点云分割。

1.场景复杂性与遮挡:

l问题:在料筐抓取、拆码垛等应用中,物体紧密堆积、相互遮挡严重。传统的基于几何特征(如法向量、曲率)的分割算法(如区域生长、RANSAC)容易失效,导致过分割或欠分割。

l分析:此问题的本质是3D视觉对场景的“理解”能力不足。解决方案正向数据驱动的深度学习模型倾斜,特别是PointNet++、PointRCNN等能够直接处理无序点云的神经网络。它们通过层次化特征学习,对遮挡和复杂背景具有更强的鲁棒性。

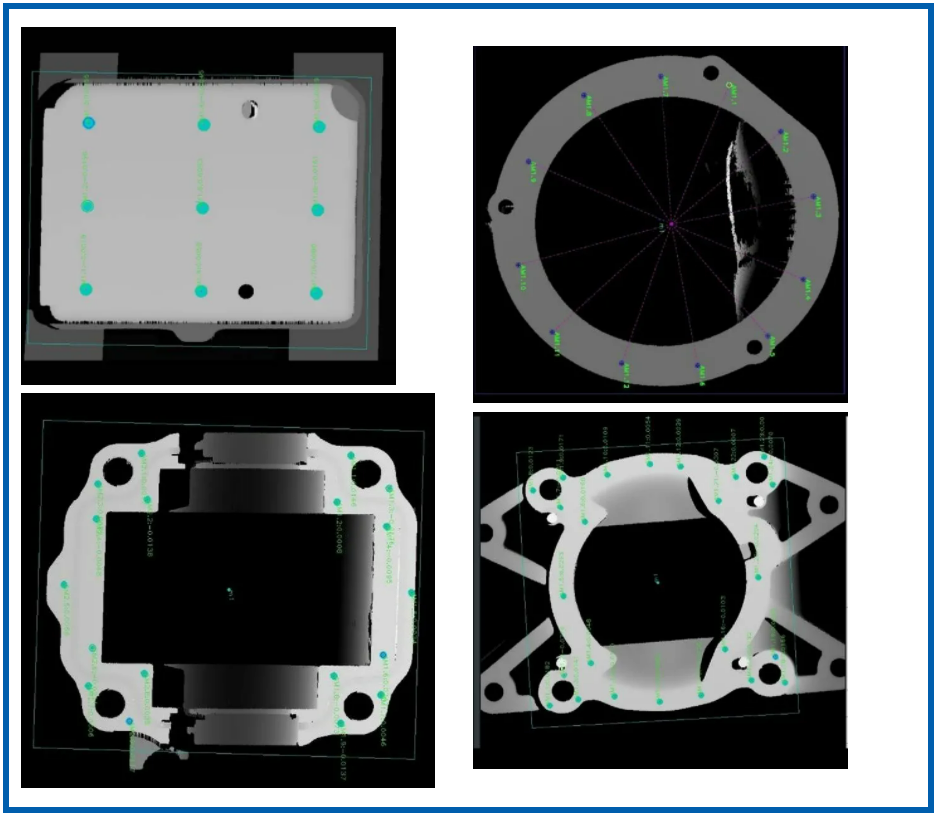

2.特征描述的鲁棒性:

l问题:如何为分割出的物体或局部表面生成一个独一无二且稳定的“身份证”,即特征描述子(如FPFH、SHOT)。在物体残缺、视角变化时,描述子的稳定性至关重要。

l分析:传统描述子依赖手工设计的几何特征,在特定场景下效果好,但泛化能力弱。基于学习的局部特征描述子(如3DMatch)正在成为研究热点,它们能从数据中自动学习更具判别力和鲁棒性的特征表示。

三、 位姿之核:3D配准与位姿估计的精度瓶颈

确定目标物体后,最关键的一步是计算其在机器人坐标系中的准确位姿(6Dof姿态:X, Y, Z, Rx, Ry, Rz),这主要通过3D配准完成。

1.初始配准的挑战:

l问题:迭代最近点算法作为最经典的3D配准方法,严重依赖于一个良好的初始位姿估计。如果初始值偏差过大,ICP极易陷入局部最优,导致配准失败。

l分析:解决此问题需要可靠的初始配准方法。通常利用特征描述子进行3D特征匹配,通过诸如RANSAC的算法快速估算一个粗变换矩阵。这一步的准确性直接决定了整个位姿估计流程的成败。

2.精细配准的收敛性与效率:

l问题:即使有了良好的初始值,标准ICP算法在处理噪声、外点和部分重叠数据时,仍然存在收敛速度慢、精度受限的问题。

l分析:对此,学术界和工业界提出了大量改进方案,如:

u点对特征:利用点对间的相对关系和特征,提升匹配的 discriminative power。

u加权策略:为不同的点对赋予权重,降低噪声点和非重叠区域的影响。

u变种ICP算法:如Point-to-Plane ICP,通过考虑局部表面结构(法向量),加速收敛并提高精度。

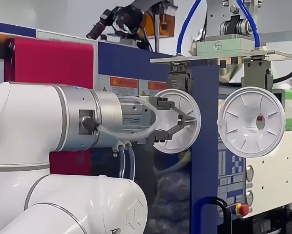

四、 系统之融:手眼标定与坐标系转换

即使3D视觉算法本身完美无缺,若不能与机器人本体精确“对话”,一切也是徒劳。这就是手眼标定要解决的问题。

l问题:手眼标定旨在确定3D视觉传感器坐标系与机器人末端执行器(或基座标系)之间的固定变换关系。标定误差会直接1:1地传递为机器人的绝对定位误差。

l分析:这虽然是一个经典的几何问题,但在实际应用中,标定板的3D重建精度、机器人自身的绝对定位精度以及标定算法的鲁棒性,共同决定了整个3D视觉引导系统的最终精度上限。这是一个系统工程问题,需要算法与精密机械的协同。

结论与展望

3D视觉引导的算法处理链路是一个环环相扣的精密系统,从点云的获取、净化,到场景的分割、理解,再到核心的位姿估计与3D配准,每一个环节都存在着固有的算法挑战。当前的发展趋势清晰地指向了深度学习与传统几何3D视觉方法的深度融合。通过学习,系统能够更好地理解场景语义、生成更鲁棒的特征、并直接预测物体位姿,从而在更大程度上克服噪声、遮挡和复杂背景的干扰。

未来,随着算法算力的提升和传感器技术的进步,3D视觉引导必将变得更加智能、高效和可靠,成为推动智能制造和高级别自动驾驶发展的核心驱动力。