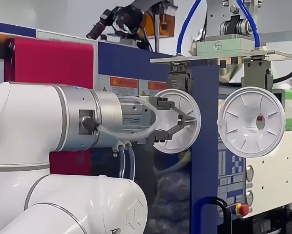

3D视觉引导技术正成为智能制造、自主系统等领域的核心使能技术,其本质在于赋予机器“慧眼”与“慧脑”,使其能够精确感知三维空间并做出智能决策。这一过程的核心支柱,在于紧密衔接、相互依赖的两大算法阶段:三维识别与三维定位。对这两个阶段的深度解析,是理解3D视觉引导如何从点云数据走向精准操作的关键。

第一阶段:三维识别——从无序数据到结构化理解

三维识别是视觉引导的“感知理解”阶段,其任务是从原始、海量且通常充满噪声的三维点云或深度图像中,提取有意义的信息,并判别目标物体的身份、类别或特定状态。

首先,特征提取是识别的基石。与二维图像处理依赖像素颜色和纹理不同,三维识别的基础是几何特征。算法需计算并提取关键点(如边缘交点、曲面突變点)、局部特征描述子(基于点法向、曲率等)、以及全局形状描述符。这些特征构成了物体在算法眼中的“指纹”,必须具备对遮挡、噪声以及视角变化的不变性,以确保在复杂工业环境中仍能被可靠辨识。

其次,分割与分类是识别的深化。面对场景中可能存在的多个物体或背景干扰,算法需进行实例分割,将属于同一物理实体的点云聚类。随后,基于提取的特征,通过预先训练的模型(如基于深度学习的点云分类网络)或模板匹配方法,对分割出的点云簇进行类别判定。此阶段输出的是对场景中“有什么物体”以及“目标物体在哪里(大致区域)”的认知,为后续的精确定位划定搜索范围并提供初始假设。

这一阶段的挑战在于处理点云的非结构化特性、环境光照与反射的影响,以及对相似物体的区分。高鲁棒性的识别算法是确保整个引导流程不发生目标混淆或误判的前提。

第二阶段:三维定位——从粗位姿到精位姿的求解

在识别阶段确定了“是什么”和“大概在哪”之后,三维定位阶段的任务是求解目标物体相对于相机(或机器人基坐标系)的精确六自由度位姿,即三个平移参数和三个旋转参数。这是将视觉感知转化为机器人可执行动作的数学桥梁,通常遵循由粗到精的迭代优化流程。

粗定位旨在提供一个接近真实的位姿初始值。常见方法包括基于特征的匹配,如将当前场景提取的特征与目标物体的三维模型特征库进行匹配,通过类似点对特征匹配等算法快速估算一个初始变换。另一种思路是基于全局描述符的检索或投票机制。粗定位不求极致精度,但求快速、稳定,避免后续优化陷入局部最优解。

精定位则是对粗定位结果的迭代优化,以达到应用所需的微米级或亚毫米级精度。最具代表性的算法是迭代最近点算法及其众多变种。该算法的核心思想是:在给定当前位姿估计下,为场景点云中的点,在模型点云中寻找最近邻点作为对应点,然后通过最小化所有对应点之间的平均距离来求解一个更优的位姿变换,并不断迭代直至收敛。为提高精度与速度,衍生算法会考虑法向信息、剔除错误对应点、或采用点到面距离度量等。

定位阶段的终极目标是最小化场景观测数据与物体预期模型之间的对齐误差。其精度直接决定了机器人抓取、装配、检测等操作的成败,面临的挑战包括局部遮挡、对称物体导致的位姿歧义、以及传感器噪声对优化过程的干扰。

协同与整合:驱动精准引导

在真实的3D视觉引导系统中,识别与定位并非严格串行,而是深度耦合、相互反馈的闭环。识别结果为定位缩小搜索空间并提供初始值;定位的中间结果或失败反馈也可能触发识别算法的重新执行或假设验证。这种协同使得系统能够应对动态环境或复杂场景。

当前,深度学习正深刻重塑这两个阶段。端到端的网络架构尝试直接从原始点云回归物体位姿,模糊了识别与定位的界限。然而,基于几何的传统方法与数据驱动的深度学习方法的融合,仍是追求高精度、高可靠性及强泛化能力的主流方向。

综上所述,三维识别与三维定位算法构成了3D视觉引导系统的核心技术引擎。识别赋予系统理解场景语义的能力,定位则提供精确的空间几何关系。二者的持续演进与深度融合,正不断突破自动化系统在柔性、精准与智能方面的极限,为高端制造、物流分拣、医疗服务等广阔领域奠定坚实的感知基础。对这一算法链条的深入解析与优化,是推动3D视觉引导技术走向更成熟应用的核心课题。